批量导出任意微信公众号历史文章,会用python写hello world就会用这个。

github在国内访问有时很缓慢,特别是图片,我把本说明文档同步放到了我的个人博客 项目中用到的wkhtmltopdf如果从github下载慢也可以点此下载后把wkhtmltopdf复制到本项目的目录下。

QQ交流群 703431832 加群暗号"不止技术流"

通过 pip install requirements.txt 安装本项目需要的库。

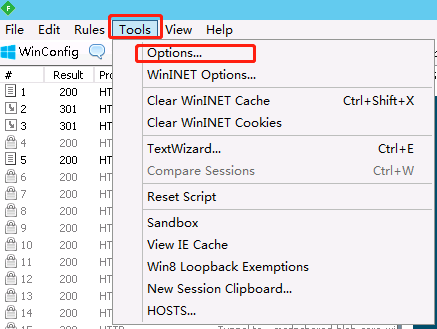

Fiddler的官网有时会连不上,可去pc.qq.com搜索Fiddler4 并安装

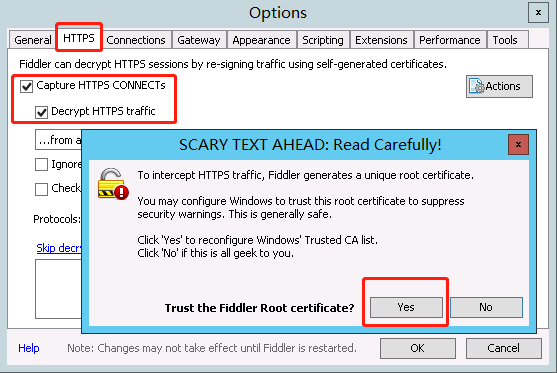

会弹出几个窗口,都点 Yes

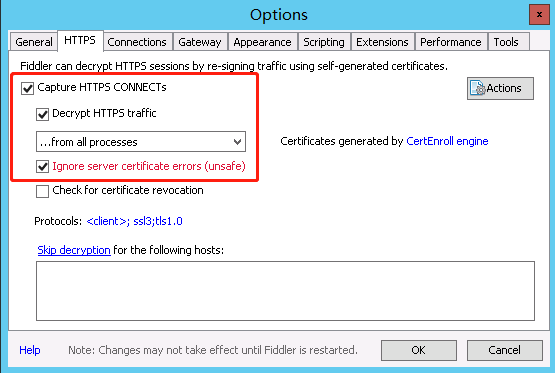

最后是这样的,打了 3 个钩。点 OK 保存即可。

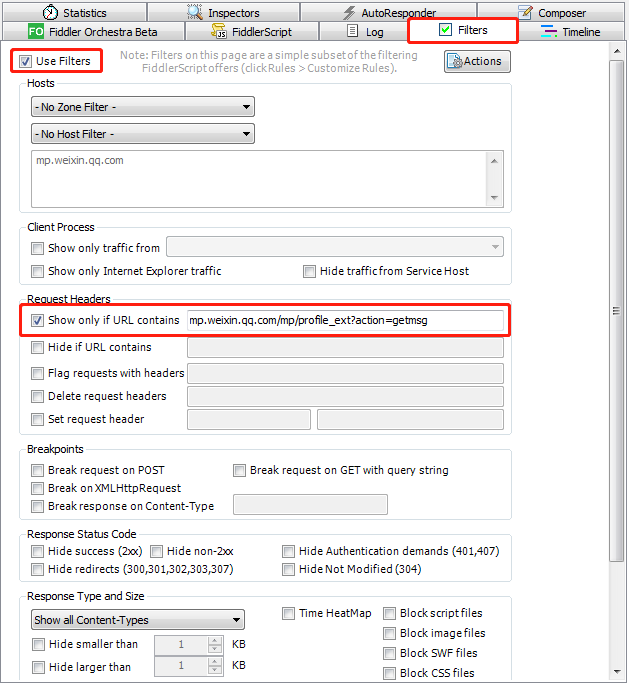

在主窗口右侧按下图所示设置

其中需要填的网址为 mp.weixin.qq.com/mp/profile_ext?action=getms

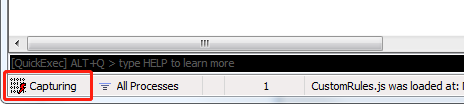

至此配置完成了,点软件左下角的方块,会显示Capturing ,表示它此时处在可以抓取数据的状态,再点一下会暂停抓取。此处先打开为抓取状态

不断下划,使历史文章列表都显示出来,但注意不要划得太快。

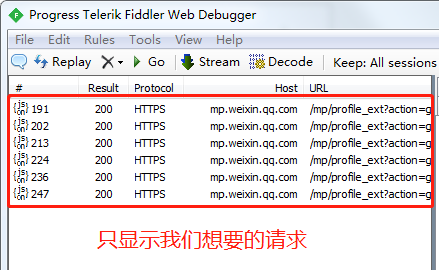

Fiddler中显示了我们需要的请求

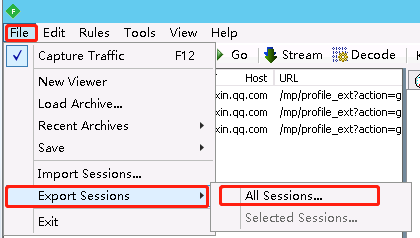

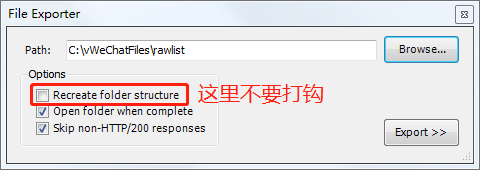

把这些请求保存下来,基中包含文章url列表

打开本项目的 config.json 文件,设置

- jsonDir:上面在Fiddler中保存的文件

- htmlDir:保存html的目录,路径中不能有空格

- pdfDir:保存pdf的目录,路径中不能有空格

记得保存

另外wkhtmltopdf.exe文件是html转pdf用的,位置不要动。

运行 python start.py #开始下载html

运行 python start.py pdf #把下载的html转pdf

企业想直接付费使用全功能版及其他公众号相关功能定制的可直达 https://www.xiaokuake.com 或添加作者微信 kakaLongcn

本开源项目仅用于技术学习交流,请勿用于非法用途,由此引起的后果本作者概不负责。

主要思路参考这几篇文章

一步步教你打造文章爬虫(1)-综述

一步步教你打造文章爬虫(2)-下载网页

特别要仔细看第3篇

一步步教你打造文章爬虫(3)-批量下载